【PAIR專訪】台灣發展自駕車的機會在哪裡?專訪ADAS系統專家郭峻因教授

作者: 人工智慧普適研究中心 撰稿

(如欲刊登或引用文章,請事先與我們聯繫取得授權,謝謝!)

台灣自2018年底無人載具創新科技實驗條例公布後,國內自駕車產業的發展進度快速提升,各地政府接連投入自駕車示範場域的建置;2019年經濟部開始受理實驗車牌的申請後,更將台灣的自駕車一舉推進到「實證上路」的階段。然而相較於歐美、日韓豐富的汽車發展經驗,台灣在這波自駕車熱潮可以掌握的機會是什麼?國立交通大學電子工程學系郭峻因教授認為,在全球的自駕車工業裡,自駕車感知系統就是台灣產業鏈的機會!

目前由郭峻因教授主持的科技部AI研究計畫「應用於ADAS/特殊用途無人載具之嵌入式AI深度學習技術」,即是發展自駕車嵌入式AI技術,團隊多年來深耕於電腦視覺開發先進駕駛輔助系統(ADAS)領域,截至目前已經累積3000萬筆深度學習物件標記資料,並且開放產學界免費使用10萬張台灣地區的ADAS/自駕車標記物件資料,此開放資料更成為IEEE MMSP 2019以及ICME 2020兩個嵌入式物件偵測競賽的訓練資料集。

郭峻因教授的研究成果相當貼近產業界的應用,團隊曾在2018年獲得奧迪汽車Audi Innovation Award,2019年與加拿大移動創新公司(Moovee Innovations Inc.)簽署技術授權合約,將深度學習技術授權到海外,同年底也在科技部舉辦的AI國際研討會中,獲得投資潛力獎第一名的殊榮。目前郭峻因教授正在參與科技部於台南沙崙的自駕車測試場域的建置,以下為人工智慧普適研究中心專訪郭峻因教授的問答內容:

郭峻因教授。(攝影:人工智慧普適研究中心)

郭峻因教授。(攝影:人工智慧普適研究中心)

Q1:最初投入自駕車研究領域的原因為何?

A: 我們以前是做影像壓縮晶片研究,行車紀錄器則是影像壓縮很重要的應用,當時行車紀錄器的廠商很多,於是團隊在做研究的過程中,也開始思考未來廠商會想要的功能。我們認為應該就是針對影像做分析,並且應用於駕駛安全上,因此九年前就從影像壓縮跨入影像分析,也就是所謂的ADAS領域研究。

我們目標是希望用嵌入式AI技術來做自駕車ADAS的感知系統,未來不管是在臺灣或者全世界的車廠,這塊都會變得重要,因為一般汽車就是開始有ADAS的功能,才逐漸邁向智慧汽車與自駕車,所以ADAS領域技術研究相當重要,導入AI技術也會讓ADAS系統更加聰明可靠。

Q2: 研究方向在自駕車產業主要扮演哪種角色,解決哪些方面的問題?

A: 我們的研究方向主要聚焦在自駕車ADAS應用的感知系統上面,我們認為這塊是可以著力的,也是臺灣產業鏈的機會,因為臺灣在整個自駕車產業中,能提供的關鍵技術主要就是模組[註1]或者感知次系統[註2],這塊在世界上是相當有競爭力的,許多隱形冠軍的產業都在這裡。而整車的部分,因為臺灣缺少汽車產業,以市場規模來講很難是主導地位,因此我們就鎖定在發展自駕車感知系統。

汽車感知系統過去都是用一般的電腦視覺,或者傳統數位訊號處理器(DSP)的雷達訊號處理來做這塊,由於人工智慧的發展,未來AI很有機會取代過去這些電腦視覺傳統規則式(Rule-based)演算法的方式,讓整個運算的結果更可靠,進而應用到不同的產業。臺灣產業界在這塊需要學術研究來支持,所以我們就扮演這樣的角色,專注在ADAS自駕車的AI感知系統上面。

另一方面,由於現在的AI技術很仰賴圖形處理器(GPU)的運算,那GPU其實是非常消耗能源的運算平台,因此它一定會有風扇來協助散熱,這些都會造成產業化的過程有很大的阻礙,一是GPU成本太高,二是風扇對整體電子系統的可靠度影響是很大的。所以我們希望把AI的運算模型精簡之後,讓偵測品質能夠滿足應用上的需要,然後把這樣的模型移植在成本較低、沒有風扇的AI晶片上面,這個是我們在這次科技部AI計畫中很重要的訴求,統稱為嵌入式AI(Embedded AI)技術,我們希望這個運算平台是很便宜、很可靠,且滿足產業的需要。

[註1]模組: 根據維基百科定義,指由數個基礎功能元件組成的特定功能組件,可用來組成具完整功能之系統、裝置或程式。

[註2]感知次系統: 如攝影機、雷達、光達、超音波等感測器元件、相關軟硬體所組成的感測系統。

Q3:目前正在執行的「應用ADAS/特殊用途無人載具之嵌入式AI深度學習技術」計畫中,您主要的研究目標與開發技術內容為何?

A: 我們的計畫就是在特殊應用場域的自駕車嵌入式AI技術。選擇特殊應用的原因就是說,現在自駕車其實國外發展得比台灣早,有很競爭的市場,那這塊是台灣沒有辦法切入的。因此鎖定特殊應用場域,如工廠無人搬運車、封閉場域的接駁車,甚至室內公共場所的無人載具來做研究,最後開發出來的技術,其實並不會被侷限在這些地方,可以廣泛應用於各式無人載具上。

在這次計畫中,我們計畫的技術主軸主要分成五部分:

- 由於AI技術一定要有標記圖資,因此我們第一個部分是放在圖資的建立,如何快速建立AI模型訓練所需要的圖資,我們稱之為資料集(Data set)。

- 第二部分是AI軟硬體的核心技術,包含軟體模型與硬體加速器,怎麼樣做到非常低功耗的硬體加速器的設計,以及精簡深度學習模型的建立,即是軟硬體技術。

- 第三部分是各種AI物件感知技術跟行為分析技術,比如人、車、機車、自行車、交通標誌、紅綠燈,甚至道路標線,這些都是重要的感知目標,同時我們也用AI來分析這些移動物件的行為,以提升車輛駕駛安全,這些統稱為感知的部分。

- 接下來就是自駕車控制的部分,希望用AI技術掌握上述提到的感知結果,來控制自駕車的油門、剎車、方向盤,我們設定的是以低速電動車,或無人載具應用為主的自駕車。

- 最後即是驗證環境,因為這些技術要上車體之前,必須要驗證它是沒有問題的,可靠度是夠的,所以我們建立了虛擬的模擬場域,利用這些模擬場域的測試,讓系統在場域裡面都能夠運作的不錯,之後才把它放到實車測試上面。所以整個計畫就包含這五個部分。

Q4:在蒐集或是標記道路影像資料的過程中,有沒有曾經發生令您印象深刻或有趣的事?

A:嗯…當然不會太有趣(笑),我們需要收集大量的道路影像資料,而這些資料要再經過標記才能放入AI模型訓練。一開始標記的工作都是人工在做,就是用現有的、或者之前自行開發的人工標記工具,然後再請工讀生協助標記。

過程中也碰到比較傷腦筋的問題,因為你很難確保工讀生都是在很好的狀態下,很專心在標記資料,所以可能會有標記不完整或是截圖比較離譜的狀況,因此會再找工讀生檢查,這個是在標記過程中,需要額外花時間與精力去確保標記品質的部分,也是做人工標記資料的時候必須要面對的課題。

當然這個過程太耗時,所以我們研發出一個快速資料標記工具ezLabel,它的標記效率是我們之前人工標記的15倍,除了基本的物件標記外,同時也有其他功能,例如物件行為標記、物件切割的像素標記、資料管理和資料分析的能力等。有自己開發的標記工具ezLabel之後,工讀生的標記品質大致有提高,因為工具本身會確保標記狀況具備一定品質,所以人工標記品質參差不齊的現象就可以大幅減少。

未來目標是走向全自動標記,目前我們已經完成第一版圖片自動標記工具,其品質相較於人工標記則更加穩定可靠 (如圖一)。我們有信心在2020年的計畫成果應該能讓標記的自動化程度大幅提高至少50倍到100倍,預計將建置6000萬筆深度學習標記資料。

圖一: NCTU ezLabel 圖片自動標記功能(標記汽車、機車、自行車、行人等)。 (圖片來源:郭峻因教授提供)

Q5:您的技術與產業界的需求相當密切,去年也曾公開發表過三項AI技術,能否簡單介紹這三項技術的內容,以及未來產業化的潛力呢?

A:這三項技術第一個就是剛剛提到的自動標記工具ezLabel,現在的效率是手動標記的十至十五倍,那全自動化是我們將來的目標。目前團隊已經有跟廠商合作,把這樣的工具安裝在廠商提供的平台,他的客戶就可以直接使用我們的工具來標記訓練AI模型所需的資料,預計將來全自動之後,會帶來更多產業化的機會。

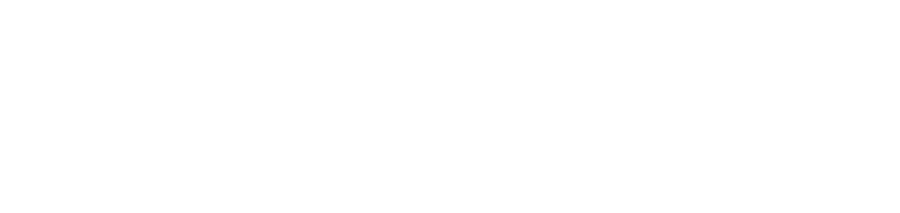

第二項技術就是高精度嵌入式 AI 物件辨識模型(如圖二)。這個其實跟前面呼應到說,我要把AI模型放到無風扇的AI晶片項目,它的運算能力雖然沒有GPU那麼高,但它的加速效率比較好,所以在運算能力受到限制的狀況下,必須輕量化你的模型,而輕量的過程不能損失精確度,所以我們要選定合適的模型做架構設計跟應用方法。這部分其實我們廠商合作是最多的,因為不管是做ADAS的公司、做自駕車的公司,或者是做AI其他應用,例如智慧交通運輸的公司,他們其實都跟我們合作技術授權(License)這個輕量化的模型。

圖二: 高精度嵌入式 AI 物件辨識模型 。(圖片來源:郭峻因教授提供)

圖二: 高精度嵌入式 AI 物件辨識模型 。(圖片來源:郭峻因教授提供)

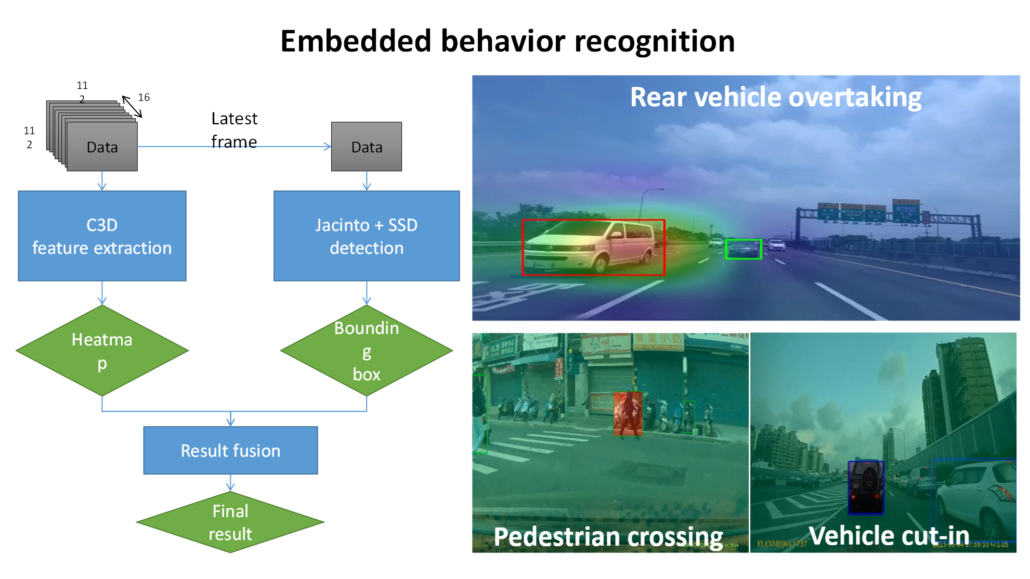

第三項技術是行為預測跟分析(如圖三),這個是我認為在未來影像式的AI很重要的一個發展方向。我們現在做物件偵測,就是你知道甚麼物件出現在甚麼地方,事實上如果你用video的角度來看,他是一個連續的畫面,所以這個物件怎麼移動,代表它正在從事甚麼行為,而AI可以來分析這個行為,所以我們也用三維CNN的模型來分析物件行為,目前這塊也有跟國內IT大廠合作,所以我想接下來這些都有很高的機會能真的落實到各種產品上。

圖三: 深度學習行為預測跟分析(後方超車、行人穿越、汽車切入等)。(圖片來源:郭峻因教授提供)

Q6:老師是國內的ADAS專家,您認為未來3到5年內,自駕車有哪些技術可以真正進入到我們的生活?

A:其實現在已經有了,所以你現在如果去買車子,你看到那個等級最好的,一定有全速域ACC系統[註3]這些已經有在高速公路上自動駕駛能力的配備,未來3到5年,這種配備只會從一般配備變為標準配備,所以會有越來越多車子直接標配ADAS系統的自駕功能。

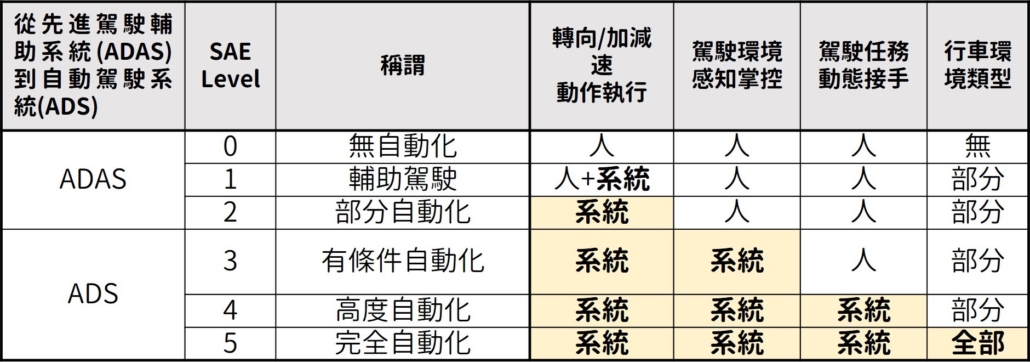

但是剛剛講的都是Level 2以下的自駕車,那Level 3以上我覺得不是技術做不到,而是責任的問題。Level 2以下是駕駛要負責,Level 3以上目前看來是車廠要負責,如果出事故那車廠要負責,因為是你的系統出事,那車廠大概不會願意負這個責任,所以我認為Level3以上的應用不會是一般在路上跑的私家轎車,而是公共運輸、接駁車這些會優先實現,因為這些提供車輛的廠商它要付出責任,就像捷運一樣,你把捷運想像是一個軌道自駕車,捷運其實都是無人駕駛,那未來的自駕公車其實也是,捷運出事捷運局要負責,不會是乘客要負責,所以我覺得未來比較可行的商業模式會是與大眾運輸有關。

第二個應用當然就是在封閉場域,像是工廠的貨物運送,或者是室內應用,例如機場、醫院等地使用的無人載具,反正出事就是提供服務的廠商要負責,這個是比較可行的,所以我認為未來幾年這樣的應用應該會陸續出現。那全自動駕駛的部份會再更久,應該還要10到15年,而且主要還是大眾運輸這塊會優先實現全自動駕駛,因為消費者的心態也是關鍵,你敢不敢搭乘是一個問題,你不敢坐就不會普及。

▲表一:自動駕駛等級。美國汽車工程師協會(SAE International)將駕駛輔助系統分為六個等級(Level 0~5)。

(資料來源: 財團法人車輛研究測試中心ARTC /圖表再製: 人工智慧普適研究中心)

[註3]全速域ACC系統::ACC(Adaptive Cruise Control),全名是主動式車距調節巡航系統,即為自動跟車系統。汽車ACC依照等級可分為「全速域」與「非全速域」,兩者差別主要為是否支援低速跟車,以及是否能一次煞停(支援時速0公里)。

Q7: 會不會以後大家都不想開車了?

A:不會,那個很難。為什麼有些人要開車子?因為他喜歡開車的感覺,你不讓他開車他反而不要,不然幹嘛要買跑車?所以這個絕對不會消失,唯一會被取代就是你不想開車的,像是公車,反正你就是要坐而已,你不會想要自己開公車,所以那個部分會被取代。

但是個人駕駛的部分還是會存在,因為我們就是想要開車,所以你要我買一部自駕車,我不會買啊!這樣就沒有駕駛的樂趣。自駕車可能取代部分的用車人,也就是本身不想開車的人,但是想開車的人他還是會開車。

Q8: 聽說您正在參與自駕車測試場域的建置,能否分享目前執行的狀況?

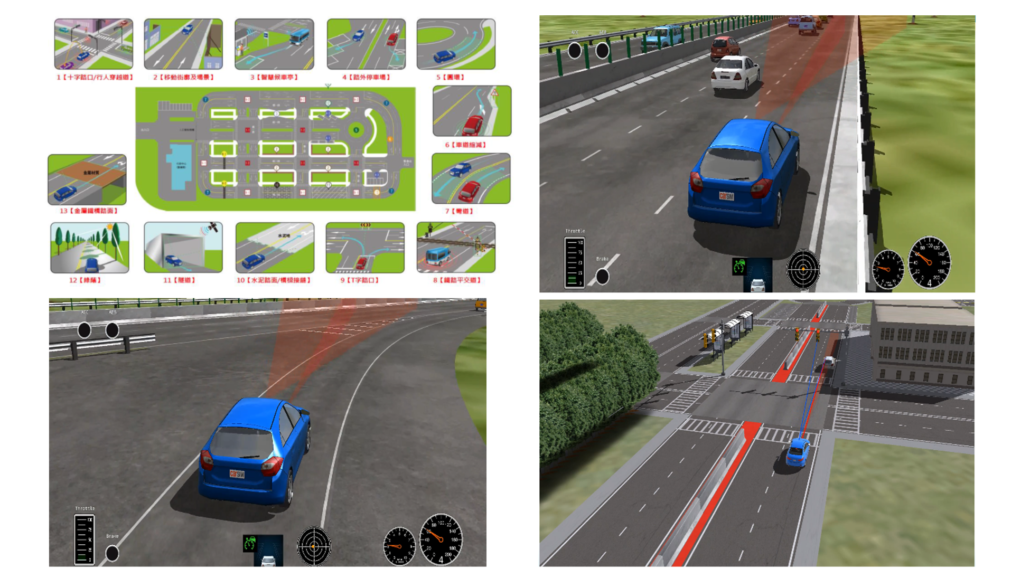

為了讓自駕車在正式上路前,能有個類似自駕車考駕照的地方,科技部特別於台南沙崙建造了自駕車測試場域,我們也協助科技部設計了沙崙自駕車場域的虛擬模擬驗證環境(如圖四),利用電腦模擬器來建置1:1的自駕車虛擬驗證場域,可以讓研究團隊在實驗室中即可測試所研發技術在虛擬場域中運行的結果,即 Model-in-the-loop (MIL) 驗證與Hardware-in-the-loop (HIL)驗證,確認正確後再到沙崙場域進行實車測試驗證。

圖四: 科技部沙崙自駕車場域虛擬模擬環境建置

圖四: 科技部沙崙自駕車場域虛擬模擬環境建置

(圖片來源:郭峻因教授再製,左上圖來源為臺灣智駕測試實驗室之自駕車場域示意圖)

Q9:這幾年大家都在討論所謂的「智慧交通」,認為智慧交通將為人類生活與城市樣貌帶來巨大革新。以您的觀點來看,您認為台灣發展智慧交通的機會在哪裡?您的技術未來將可能應用於智慧交通的哪個地方?

A:智慧交通其實很廣啦,就是說在基礎建設裡面加一些智慧物聯網(AIoT)的科技,同時包含自動駕駛車,讓交通事故降低,這個當然是我們應該要做的,但這需要政府的投資,因為一般消費者,或一般民間企業不會投資這個東西,政府如果有魄力去做,一定可以做。

現在一些都市有所謂智慧交通的示範區,名字可能都不太一樣,但是這個示範的結果會推廣嗎?不知道。所以我覺得將來能不能普及,政府的態度其實很重要,如果政府把這個東西當作自己的責任,那它就會普及;如果他認為反正這是為了選舉考量,或者是為了施政要有亮點,那可能就是曇花一現,示範完就結束了,這個沒有政府的資源是不可能的。

所以智慧交通要普及,一定要有廠商願意投資,廠商如果在這樣的商業模式裡面能賺到錢,它才會願意投資,這是政府要設計的問題,例如開放一些政府的資源,雖然我不太清楚可以開放什麼,這部分我不是專家,不過就是要讓廠商願意投資,智慧交通才有可能會實現,因為政府本身沒那麼多錢。

智慧交通的建設在全世界都一樣,就看政府的態度,認為怎樣的投資是對這個地方有幫助的,一步一步來進行,因為整個改變需要蠻長的時間,所以政府可以先從一些連網的裝置開始,用交通號誌連網、路側設備連網,然後再結合安全的、智慧的、AIoT的技術,慢慢一步一步來打造。它要一步到位應該也很困難,但政府一定要願意去嘗試改變。

至於我們目前所研發的嵌入式AI技術,可以應用於ADAS/自駕車系統中。先進駕駛輔助系統(ADAS)主要目的是協助提醒車輛駕駛人進行危險警示,並介入控制車輛避免發生碰撞,其功能包含車道偏移警示(Lane Departure Warning System, LDWS)、前方防碰撞警示(Forward Collision Warning System, FCWS)、車側盲區偵測(Blind Spot Detection, BSD)、行人偵測(Pedestrian detection), 自動緊急剎車(Autonomous Emergency Breaking, AEB), 車道維持系統(Lane Keeping Assistance, LKA), ACC(Adaptive Cruise Control) 等等。

過去八年來,我們已研發出25項基於視覺之ADAS功能技術,並協助國內廠商進入ADAS系統相關產品之研發與落地。先進駕駛輔助系統(ADAS)目前已經在近期上市之新車車款中可以選配,未來發展智慧交通時,它也會是自動駕駛車必備的功能。

Q10:對於未來想投入這個研究領域的高中生或大學生,您有哪些觀點或建議想跟他們分享?

A:我覺得台灣的學生其實都滿有創意的,但是我們的自信心不夠,看到人家很厲害,就害怕自己做不到,如果我們能把自信心培養起來,事實上我們做出來的東西,都可以跟國際研究團隊一樣擁有讓人驚艷的地方。

台灣的民族自信心不夠強,相較於日本人、韓國人、大陸人的自信,可能還沒開始比,人家就贏你一半了,因為那是信心的問題,對自我肯定的問題。台灣學生有機會要到國外看一看,其實我們的能力也不差,但就是缺乏信心跟積極的態度。

所以未來不管同學想做哪個領域的研究,這兩點要先把握,一是建立自信,二是態度積極。機會並不會自動掉下來,你要自己去爭取,我想這個是我們台灣學生可以再稍微注意的地方,其他像是聰明、創意等部分,我們都是相當好的。

人工智慧普適研究中心PAIR Labs 介紹

為營造台灣創新人工智慧生態體系,2018年科技部於台灣大學、清華大學、交通大學、成功大學補助成立4所國際級AI創新研究中心。設立於交大的人工智慧普適研究中心(Pervasive Artificial Intelligence Research Labs,簡稱PAIR Labs),以「智慧技術」及「智慧服務」為主軸,積極推動AI相關研究以達成尖端技術研發、國際學者交流、AI人才育成、產學合作及孕育新創等目標。目前轄下共有18個AI計畫團隊,成員來自全台25所學校,參與AI計畫之團隊人數超過500人,研發能量龐大,是AI專業人才的聚集地。

- 官網: https://pairlabs.ai/zh/

- Facebook粉絲專頁: https://www.facebook.com/pairlabs/

更多關於郭峻因團隊的介紹,請見以下連結:

- 研究計畫介紹:應用於ADAS/特殊用途無人載具之嵌入式AI深度學習技術

- 產學合作:若您對於郭峻因教授團隊的自動化圖資標記與資料庫建置、深度學習軟硬體核心模型開發與加速器設計、各式 ADAS/自駕車應用感知深度學習技術、自駕車駕駛控制技術與系統模擬驗證環境等技術感興趣,歡迎聯繫我們進一步洽談產學合作!